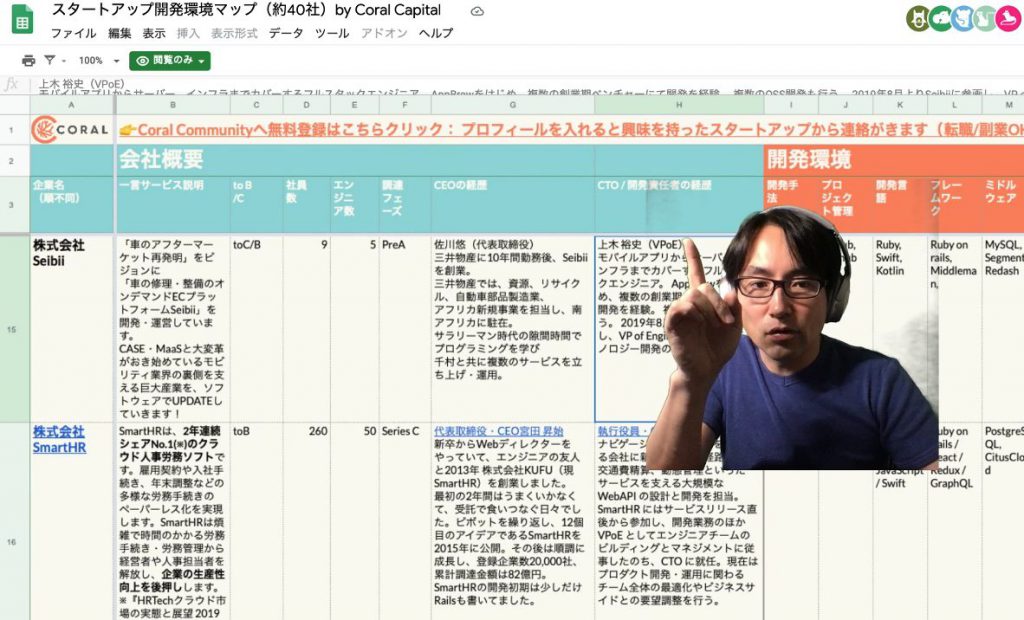

Evernoteの元CEO、フィル・リービン氏が2020年7月7日にベータ版として発表した「mmhmm」(ンーフー)が、わずか3か月後の10月8日に名門VCのSequoia Capitalをリードとして約33億円(3,100万ドル)のシリーズAの資金調達を発表しました。リービン氏は「ジョークのような感じで始まった」と言いますが、ベータローンチから3か月目にしては大型のシリーズA調達です(この投資ラウンドには三木谷浩史氏や中島聡氏ら日本の投資家・経営者、WiLやScrum Venturesなど日系VCも参加しています)。

何がすごいのでしょうか?

mmhmmもそれ自体が非常に斬新で便利なアプリですが、私にはそこに大きな時代の変化の予兆があるように思えるのです。テレビの世界で1990年代から天気予報番組などで利用されてきた「クロマキー合成」という画像処理技術が一気に民主化し、多くのサービスやアプリに偏在するようになるのではないか――、ということです。

以下がリービン氏による説明とmmhmmのデモです。

最近YouTube動画撮影のためにグリーンバックを購入して人物と画像(画像や動画)を合成した映像ストリームを作ってみる中で、そう思うようになりました。例えば以下のような映像です。ここでは仮に「気象予報士UI」と呼びましょう。

気象予報士UIが一気に民主化するのではないかと考える背景には2つの技術革新があります。他方、ユーザーニーズとしてはオンラインコミュニケーションやコラボ時の「ヒトの見える化」のニーズがコロナを機に顕在化したことがあります。

テレビの天気予報では、気圧配置を示す天気図を背景にして天気予報士が前面に立って解説したりします。これは古くからある画像合成技術で、映画やCMなど高単価な領域ではデジタル以前から100年近い歴史があるようです。1990年代に入るとコンピューターによる画像処理が著しく発達し、単色(通常はグリーン)のシートの前で人物を撮影した映像に対して、後から特定の色のピクセルを別の映像と合成するということが盛んに行われるようになりました。

この映像処理は20年前にはテレビなど業務の世界では一般的でしたが、個人が使う一般のPCでは普及しておらず、まして非力なモバイル端末では到底実現不可能でした。

深層学習と深度カメラという2つの技術革新

ZoomやTeamsといったビデオ会議アプリにはクロマキー合成の簡易版とも言える背景画像の合成機能があります。背景画像として動画も使えます(技術的に難しいのは「映像中の、どのピクセルが人間か?」を判定するところなので、背景画像は静止画も動画も大して変わりません)。8月5日にリリースされたZoomの新バージョンからは、以下のように資料スライドの上に切り抜き人物のオーバーレイ表示ができるようにもなっています。

Zoomの背景画像選択は簡単ですが、限界もあります。Zoom飲み会をやったことがある方であれば「カンパーイ」とビール缶をカメラに向けたとき、ふっと腕の真ん中あたりから腕ごと缶の映像が消えてしまうことにもお気づきかと思います。詳細な実装は分からないものの、これはZoomの人物認識精度の限界(もしくはCPUやGPUを使いすぎないためのエンジニアリング上の設計)を示していると思います。

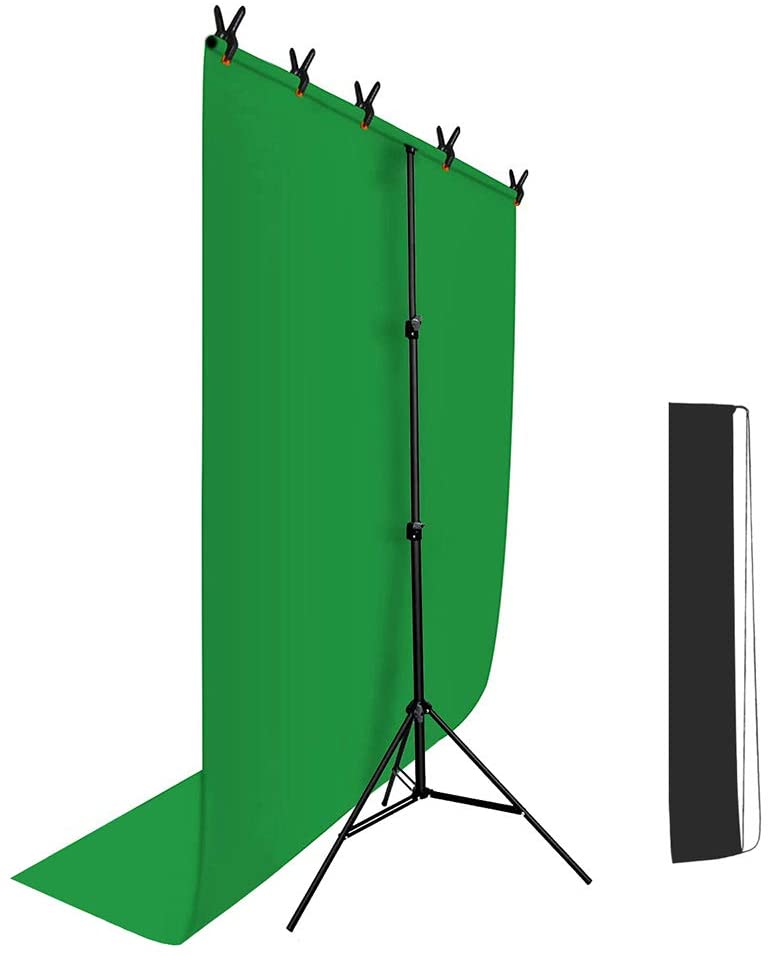

Zoomでもグリーンバックを使うと、この問題は解決します。私は最近以下のようにカーテンのようなグリーンの布を購入して背景として使っています。グリーンバックを使うと人物と背景の境界部分の認識精度がきわめて高くなり、テレビの天気予報で見るのに近い自然な合成ができます。これは当然のことで、Zoom側で必要な画像処理は、緑色のピクセルを別の映像(の同じ位置のピクセル)に置き換えるという単純な処理で済むからです。

映像の自然さとしてはグリーンバックを使ったほうが良く、恐らく処理負荷も低いのでしょうが、技術的に凄いのはそうした特殊な設備なしに、かつてクロマキー合成と呼ばれた映像合成ができることのほうではないでしょうか。この背景画像の合成機能をZoomで利用するにはパソコン側に一定以上の性能が必要となります。つまり、まだ最新のパソコンでやっとできるようになったことなのです。

Zoomの実装詳細は分かりませんが、例えば、オープンソースで同等の合成処理をする「DepthBackSub」を見てみると、汎用の深層学習のフレームワーク「TensorFlow Lite」を使って秒間10フレーム程度であれば「人物を映しているピクセルかどうか」の判定は簡単に実装できるようです。これは画像処理の定番ライブラリとして長年使われているOpenCVのエッジ検出などと異なる、深層学習の成果ではないでしょうか。

もう1つ、技術的な変化として挙げられるのが深度カメラ(3Dカメラ)に普及の兆しがあることです。最近のハイエンド・スマホは複眼になりつつあります。2つ以上のレンズを備えることで、広角・望遠の使い分けができるだけでなく「視差」を利用した対象物の距離の概算ができるようになっています。被写体までの距離は深度情報と呼ばれ、最近のスマホ写真には色情報と同時に、各ピクセルに深度が記録されています。これはFacebookの3Dフォトなどで見る、スクロールすると立体的に写真が前景・後景に分かれて動く映像などで利用されています(ちなみに機械学習を使うことで、単眼レンズでも同様の3Dフォトのような効果を擬似的に作り出せると2020年2月にFacebookは発表しています)。

今のところ深度カメラはVRやARの文脈、あるいは産業用途で語られることが多いですが、前景にある人物の輪郭を認識する有用な情報となるので、複眼カメラなら気象予報士UIは簡単に実現できそうです。実際、最近のiPhoneのカメラアプリに搭載されている「ポートレイトモード→スタジオ照明」などは深度情報を使って人物をきれいに抜き出してくれたりしますし、SnapやInstagramのReelといったアプリでも人物の認識精度はきわめて高いように見えます。一方、Snapのカメラ機能をデスクトップ版として提供する「Snap Camera」を見てみると、CPUやGPUの機能要件は結構高めであることが分かります。

つまり、深層学習や深度カメラの普及、あるいはPCの性能向上によって、グリーンバックなしの動画中の人物の切り抜きがリアルタイム(1秒間に30枚の処理速度)でできる準備が整いつつあるということではないかと思うのです。

今でも静止画であれば画像処理アプリやクラウドなどを使って数秒ほどで精度高く人物の輪郭推定が可能です。つまり、人物の輪郭検知処理は、使っているデバイスの性能、求められる精度、画像解像度によって1フレームあたり0.01秒から10秒という処理時間のばらつきがあるわけです。リアルタイムの動画では1フレームを0.03秒で処理しなければいけませんから、まだあらゆるデバイスでリアルタイムに気象予報士UI(の映像送信)が実現できるわけではありません。PCですら処理性能が足りないケースがあります。

今後、市場ニーズと結びつけば、気象予報士UIは一気に民主化するのではないかと私には思えるのです。

ゲーム配信で使われてきたOSSが民主化する

ここまで読まれた方の中に、そんな映像合成はゲーム配信では何年も前からみんなやってることじゃないかという人もいるかもしれません。これはその通りで、ここに私は過去に何度も見てきたイノベーションのパターンがあると思うのです。巨額の資金が動く市場がすでにあり、そこで起こる技術進化が別の領域にスピルオーバーするという現象です。

例えば、深層学習民主化の背後にあったのはグラフィック処理専用チップ、GPUの急速な進化でした。その研究開発を資金面で支えたのはゲーム市場です。

全く同様にTwitchから始まるゲーム配信の世界では、すでにクロマキー合成は日常的に使われていて、かなり高度な映像配信が行われています。ただ、今のところはグリーンバックや「OBS Studio」のようなオープンソースのソフトウェアの導入と設定が必要で、かなり面倒です。

しかし、私自身やってみてハッキリと理解したのは、これはゲーム実況以外のビジネス用途でも利用価値の高い応用技術だということでした。

mmhmmが見せた民主化の重要性

Evernoteの元CEO、フィル・リービン氏が率いるmmhmmは、OBS Studioのようなソフトウェアを、一気に民主化して広める可能性を感じさせるのに十分でした。OBS Studioは、ちょっとPCに詳しかったり映像配信に凝ったりする層しか存在を知らないものでしょう。また一般利用者が使いこなすことも考えづらいものです。mmhmmは、それを変える可能性を秘めていると思います。

OBS Studioは極めて高機能なソフトウェアで、オープンソースらしくユーザーの要望が全部入っているように見えます。あらゆるところにパラメーター設定があり、ソフトウェア設計としても機能拡張が容易になっています。逆に言えば、プロが使う一眼レフカメラのようなものです。一方、一般ユーザーが求めているものは、どんな状況でも100点満点中80点の写真が取れる最近のスマホのようなカメラではないか、と私は思います。それがOBS Studioとmmhmmの関係です。

mmhmmはまだベータ版ですが、少し使ってみれば、利用シーンを限定してシンプルなUIにうまく必要最低限の機能を落とし込んでいることが良く分かります。グリーンバックなしのクロマキー合成(正確にはクロマキーではありませんが)は、mmhmmでは最初からこのアプリの最大の特徴です。逆にOBS Studioでグリーンバックなしのクロマキー合成をするには別のソフトウェアをインストールしないとできなかったりします(例えばPerfonifyのクロマカムとOBSを組み合わせる)。グリーンバックを買うという選択肢があり得ない一般ユーザー層向けとしては決定的にmmhmmが勝っていると思います。

まとめると、こういうことです。

気象予報士UIの民主化が始まる要素技術はそろいつつあります。個別にはソフトウェア実装もあり、ビデオ会議でも実装が進んでいます。マニア層では何年も利用もされています。ただ、ビジネス向けに必要な形でパッケージして、使いやすいUIとともに非ゲームやYouTube配信用途以外にも向けてマーケティングしたのは、mmhmmが初めてだったのではないでしょうか。そして、これはmmhmmにとどまらず、より広い範囲のビジネス系SaaSでも使われていくのではないかと思うのです。

顔が見える系コラボツールのスタートアップ

「気象予報士UI」が民主化する予兆は、過去10年でもネットやアプリの世界ではたくさんあったように、私には思われます。画面の中に顔が増えていて、しかも顔アイコンが丸くなったのは、ここ10年のことです。

かつてSNS黎明期にはユーザー画像は四角い画像が一般的でしたが、今では顔を中心にして丸く切り抜いた円形に進化しました。これはブラウザ標準規格としてCSS3が策定され、丸い切り抜きが1行で実現できるようになったことも影響しているかもしれませんが、表示ピクセル数に占める顔の比率が上がっているということとも考えられます。

顔の表示面積が増えたのはPCやスマホの画面全体でも同じです。ある瞬間にディスプレイ上に表示されている人間の顔の数というのは、2000年のネットと2020年のネットでは10倍くらい差があるのではないかと思うのです。今やクラウド上のB向けツールなどでもユーザーが見ている画面に顔が溢れていることも珍しくないですが、かつては文字情報と少しのグラフィックだけでした。考えてみれば、顔文字やEmojiの普及も全く同じ文脈の中にあるように思えます。

「四角い顔写真→丸い顔写真→切り抜き上半身動画(天気予報士UI)」と進化するのは自然なことに思えます。そしてGoogle Docsのようなコラボツールで同期コミュニケーションするタイミングでは切り抜き人物動画が表示され、文書を取り囲みながらちょっとした会話ができるのが良い場面があると思います。

今後、多くのコラボツールにリアルタイムのユーザーの顔が表示されるようになり、オンラインで出会えばその場でしゃべれるようになる、というのが今の私の予想です。現在、丸く小さな顔アイコン程度であるユーザー表示の一部が、徐々に天気予報士UIになっていく予兆はAroundやTandemといったスタートアップにも見られます。これらのスタートアップはクラウド上のコラボツールで複数人が作業しているときに丸い顔アイコンや顔動画が重ねて表示されるようなサービスを提供しています。Aroundもmmhmmも、ユーザーが顔の向きや姿勢を変えても、常に顔のど真ん中を丸く切り出すような顔追跡機能を提供しています。

ビジネス用途ならプレゼンやブレスト、SaaSならユーザーサポートやロータッチのオンボーディングの場面で天気予報士UIは有効に思えます。教育分野なら講義やグループディスカッション、ECサイトなら顧客対応。グループ購買時に友人や家族の顔が見えてしゃべれると楽しそうだと思いませんか? 高単価商材なら店員が見えて、画面上の商品周辺でしゃべることはエンゲージメントにプラスでしょう。

遠隔医療でも、医療画像や解説図を示しながら説明するとき、医師と患者で視線の向く先を画面内で一緒に見つつ、その近辺に互いの上半身が合成されて表示されるようになるのではないかと思うのです。オンラインのボードゲームなら、どこか1箇所に四角くプレイヤーのビデオ映像を出すよりも、気象予報士UIでボード上の空きスペースに顔を出し、局面に応じて各人が場所を移動すれば楽しそうに思えるのです。

考えてみると、いまのビデオ会議には「誰が、どこを見ているのか」という視線に関する情報が完全に欠落しています。天気予報士UIで、誰もが自分の画面上の表示位置をコントロールするようになれば事情は変わります。ユーザーが画面上のどこに表示されているかは、当該ユーザーの意図(視線)を示すわけですから、これは単純にビデオ会議から人物映像を切り抜いただけの話ではなくなります。Go Proがそうですが、私たちには「その人が見ているものを見たい」という習性があると思うのです。

デバイスの処理性能もネットの帯域も上がっていく今後、ネット上のコミュニケーションやコラボツールの中に、ますます動画要素が溶け込んでいくのは間違いありません。個人的には、そのとき顔はきわめて重要な要素になると思っています。皆さんは、どう思われますか?